AIOPS是什么,它与AI有什么关系?

现如今,AI 这个词已经被玩坏了。很多公司都声称自己在做 AI,但其实并没有。不过有另外一种新兴的 AI,各种类型的 IT 企业倒是可以尝试,而且完全不需要人工参与。

AIOps,也就是基于算法的 IT 运维(Algorithmic IT Operations),是由 Gartner 定义的新类别,源自业界之前所说的 ITOA(IT Operations and Analytics)。我们已经到达了这样的一个时代,数据科学和算法正在被用于自动化传统的 IT 运维任务和流程。算法被集成到工具里,帮助企业进一步简化运维工作,把人类从耗时又容易出错的流程中解放出来。人们不再需要在遗留的管理系统中定义和管理无穷无尽的规则和过滤器。

在过去的几年间,一些新技术不断涌现,利用数据科学和机器学习来推进日益复杂的企业数字化进程,“AIOps”(Algorithmic IT Operations)因此应运而生。Gartner 的报告宣称,到 2020 年,将近 50% 的企业将会在他们的业务和 IT 运维方面采用 AIOps,远远高于今天的 10%。

为了更好地理解 AIOps 和 AI 的区别,我们需要从头说起。

AI 简史

AI 一词用于描述机器(或软件)模拟人类认知的过程。也就说,机器学习像人类一样思考。40 年代,Alan Turing 掀起了 AI 热潮,但受限于计算机的计算能力,也只发展到今天的这个阶段。

问题是,我们为什么要让机器模仿人类?而为什么有些 AI 应用程序会比其他的更成功?发展 AI 的目的在于解决人类的问题,所以我们会看到像自动驾驶汽车、行为分析这类复杂的解决方案。

话说回来,IT 运维环境有一些不一样的地方。我们不会直接管理人类,我们与应用程序和基础设施打交道。而且它们可能更加复杂和不可预测,因为它们不是人类。

人类思维与机器思维

AIOps 的不同之处在这里体现出来。AIOps 的解决方案专注于解决问题,而且是通过使用基于算法的技术来高度模仿人类(而且以更快的速度和更大的规模)。算法的效率提升了 AIOps 的价值,而相对于人类的智慧——虽然是无限的,但不如机器来得高效。

当然,人类也能进行高效的 IT 运维。AIOps 的目的是为了让我们的生活变得更美好,但是当人类与 AIOps 参合在一起,它们之间的界限就会变得模糊。高级的 AIOps 会使用神经网络技术,它会向运维人员学习,然后尝试消除无聊的重复性劳动。

未来的公司

为什么公司需要 AIOps?现代的 IT 环境已经无比的复杂,而且千变万化,需要我们花费大量的时间和资源去监控、去诊断问题、去解决问题。很多公司处于被动的地位。但是如果他们使用了 AIOps,他们就可以利用先进的算法,花更多时间在其他更有意义的工作上,而不是重复地解决相同的问题,或者花时间管理规则和过滤器。

我们所说的规则,可以把它们简单地描述为“如果是这样那么就这么做”,它们能够应付简单的场景,但是很难扩展。相反,算法和机器学习提供了更加灵活的表达方式,不仅强大,而且健壮,能够应付不断变化的需求。这将带来更高的效率和更低的成本。对于厂商来说,他们面临的挑战在于将整个技术方案打包,避免把用户暴露于底层的复杂性当中。光是提供工具是不够的,企业需要招聘数据科学家而不仅仅是工程师。

前行之路

借助智能算法的技术优势,原先人工需要几个小时完成的任务现在通过自动化可以在几秒钟内完成,而且能够得到更好的结果。传统的 IT 运维需要管理大量的告警,极大地分散了企业的注意力,他们需要花很多时间解决无聊的问题,没有时间用于创新。使用 AIOps 可以解决这些问题,把运维人员从纷繁复杂的告警和噪音中解脱出来。各个行业的企业正在采用 AIOps,他们使用这项技术来改进客户的数字体验——银行、娱乐、交通、零售,甚至政府。

尽管 AIOps 还是一个新名词,但并不代表它只是未来的一种趋势而已。在这个数字的年代,任何使用传统技术来管理机器数据的组织要么忽略了信息的价值,要么已经让他们的运维团队不堪重负。随着数据的暴涨,CIO 们应该快速拥抱 AIOps。传统 AI 仍然会在某些领域发挥它的作用,而 AIOps 将为企业带来最直接最深远的价值。

文章来自微信公众号:高效开发运维 收起阅读 »

深度解析Intel CPU漏洞为何如此恐怖?

据悉,Meltdown和Spectre这两个漏洞可以绕过内存访问的安全隔离机制,使用恶意程序来获取操作系统和其他程序的被保护数据,造成内存敏感信息泄露。

事件的起点是Intel市售处理器被爆出因为设计的缺漏,会造成原本普通的程序却可以拥有前所未有的高权限,甚至可以直接访问核心内存当中的数据,这对于用户隐私和设备安全无疑是多年来前所未有的噩梦。

[深度解析Intel CPU漏洞为何如此恐怖]

这次的漏洞之所以备受关注,是因为这些漏洞能让恶意程序获取核心内存里存储的敏感内容,比如能导致黑客访问到个人电脑的内存数据,包括用户账号密码、应用程序文件、文件缓存等。

此次两组漏洞拥有内核级别的高权限,潜在的危害性、影响的广阔性、解决的棘手性都始料未及。

此次事件还带来了哪些严重影响?针对此次漏洞应如何及时补救?关注2月2日14:00“深度解析Intel CPU漏洞为何如此恐怖”直播活动,元鼎科技资深安全大咖王国斌为您指点迷津。

直播间入口:http://www.otpub.com/home/live/liveinfo/liveid/10117.html 收起阅读 »

解析一二线城市的互联网的“趋势 · 应用 · 互联”

互联网+开始向各行各业渗透,从“人人相联”向“万物互联”迈进。在产业周期的更迭中,驱动全球互联网创新演进的资本、技术、数据、需求四大要素持续演化。

经济发展在新一代互联网产业中扮演什么角色?

传统企业如何实现信息化、数据化、在线化?

互联网企业如何引进来、走出去?

一线互联网技术人才视野在哪里?

二线互联网人才该如何进阶封神?

敬请关注12月10日9 : 00“中国【郑州】开发者大会”解码未来开发者直播活动,拥抱一线互联网技术趋势,关注技术在商业中的应用,积极实现一二线开发技术、思维、环境等的互联!

活动流程

09:00-09:05 主持人开场

09:05-09:15 主办方致辞:大象融媒负责人

09:15-09:25 主办方致辞:大象互联网圈发起人王向阳

09:25-09:45 技术创业下赛道的选择与实践:UU跑腿创始人&CEO乔松涛

09:45-10:05 工业大数据解决方案分享:阿里云架构师涂铭

10:05-10:25 移动端内容分发技术架构解析:迅雷AI以及推荐系统业务主管张升涛

10:25-10:45 详解车辆自动驾驶系统:宇通自动驾驶实验室第二负责人惠作奎

10:45-11:05 唯品会大数据架构及应用实践:唯品会资深数据架构师李创

11:05-11:50 趋势·应用·互联论坛

11:05-12:00 大象互联网圈&大象融媒战略签约仪式

13:30-14:00 面向未来的运维开发一体化——DevOps体系及实践:DevOps时代发起人、高效运维社区发起人萧田国

14:00-14:30 汽车之家数据库平台化实践:汽车之家架构师蔺瑞超

14:30-15:00 职场思考的快与慢:汽车之家开发经理李占斌

15:00-15:30 B站数据平台建设实践:Bilibili数据平台技术经理薛赵明

15:30-16:00 大数据营销:平安好房用户策略团队负责人胡辰

16:00-16:30 OpenPitrix平台中的微服务:开源文化布道、青云基础设施产品经理李建盛

16:30-17:00 基于人脸识别的人证合验采集平台的建设:中软高科产品经理张广举

17:00-17:50 拥抱·转型·发展论坛

17:50-18:00 项目展示时间

听企业家、互联网大牛们聊聊一二线互联网“趋势 · 应用 · 互联”那些事儿!

直播间入口:http://www.otpub.com/home/live/liveinfo/liveid/10082 收起阅读 »

fir.im持续集成技术实践

持续集成做什么

持续集成的概念出现在 2001 年,它其实是一个 XP 极限编程的工程实践。那么持续的是什么,集成是什么呢,非常简单就是“一直不停地集成代码”。

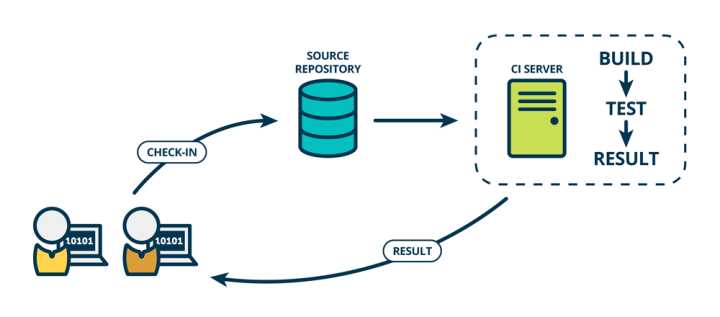

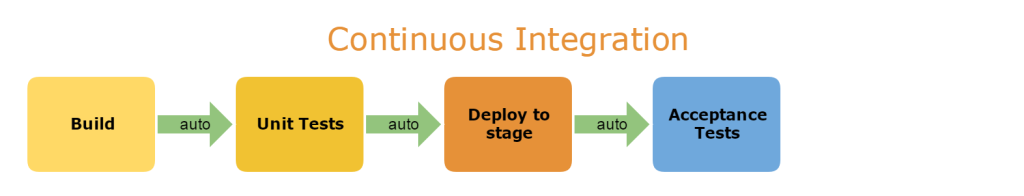

持续集成是把代码频繁的合并到主干,通过自动构建的方式验证软件的质量,让团队快速的响应质量,快速的修复问题,快速的给客户解决问题,快速地交付更好的软件质量。

我们为什么要做持续集成

开发人员对下面的软件开发场景很熟悉,比如:

- 场景一:开发了新功能,老功能产生新的 bug;

- 场景二:修好一个 bug,又产生其他 bug,甚至出现连环 bug;

- 场景三:出现的 bug 比较多,修改代码要很谨慎,不熟悉的模块一般不敢动,怕引起问题;

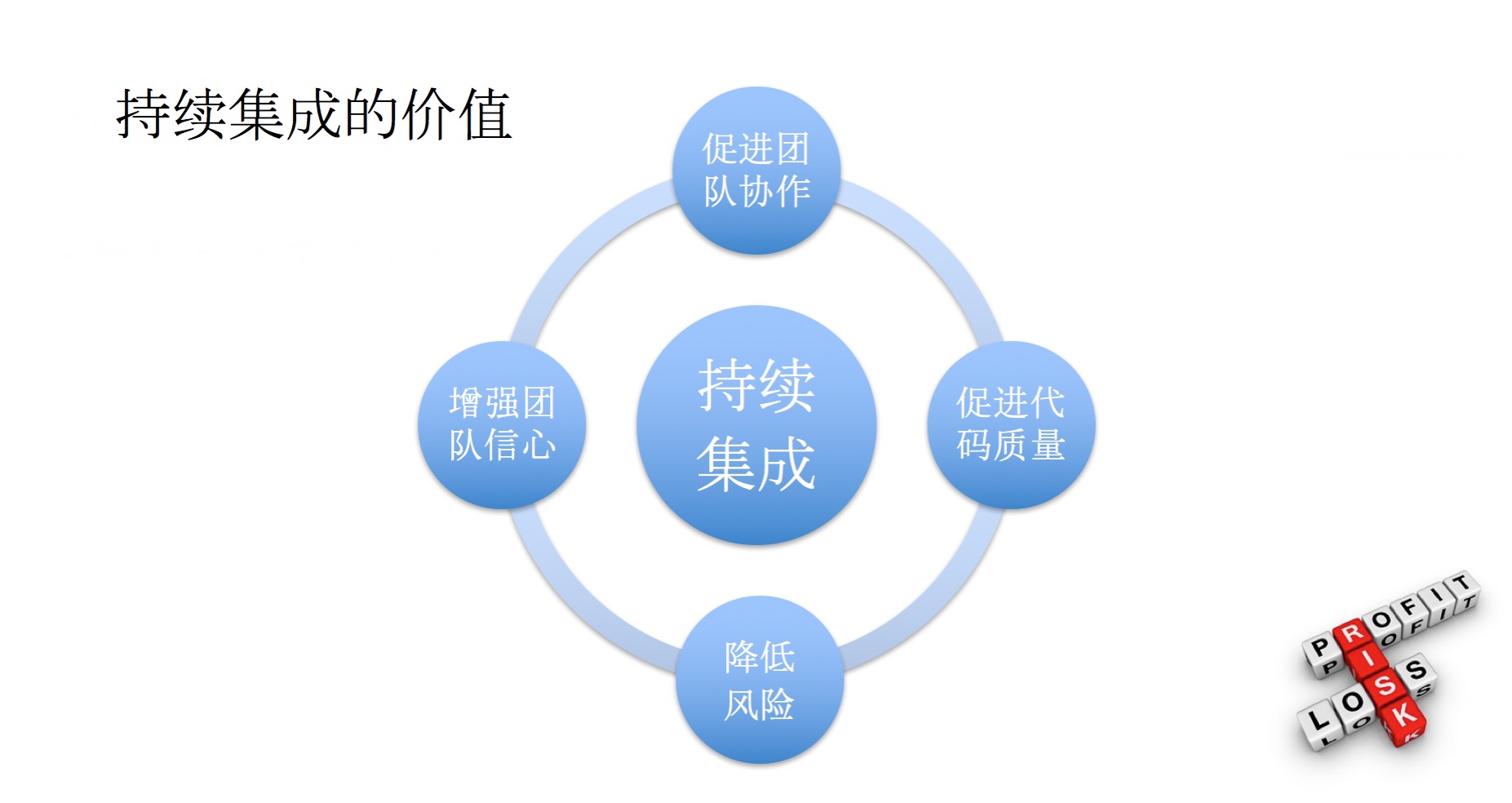

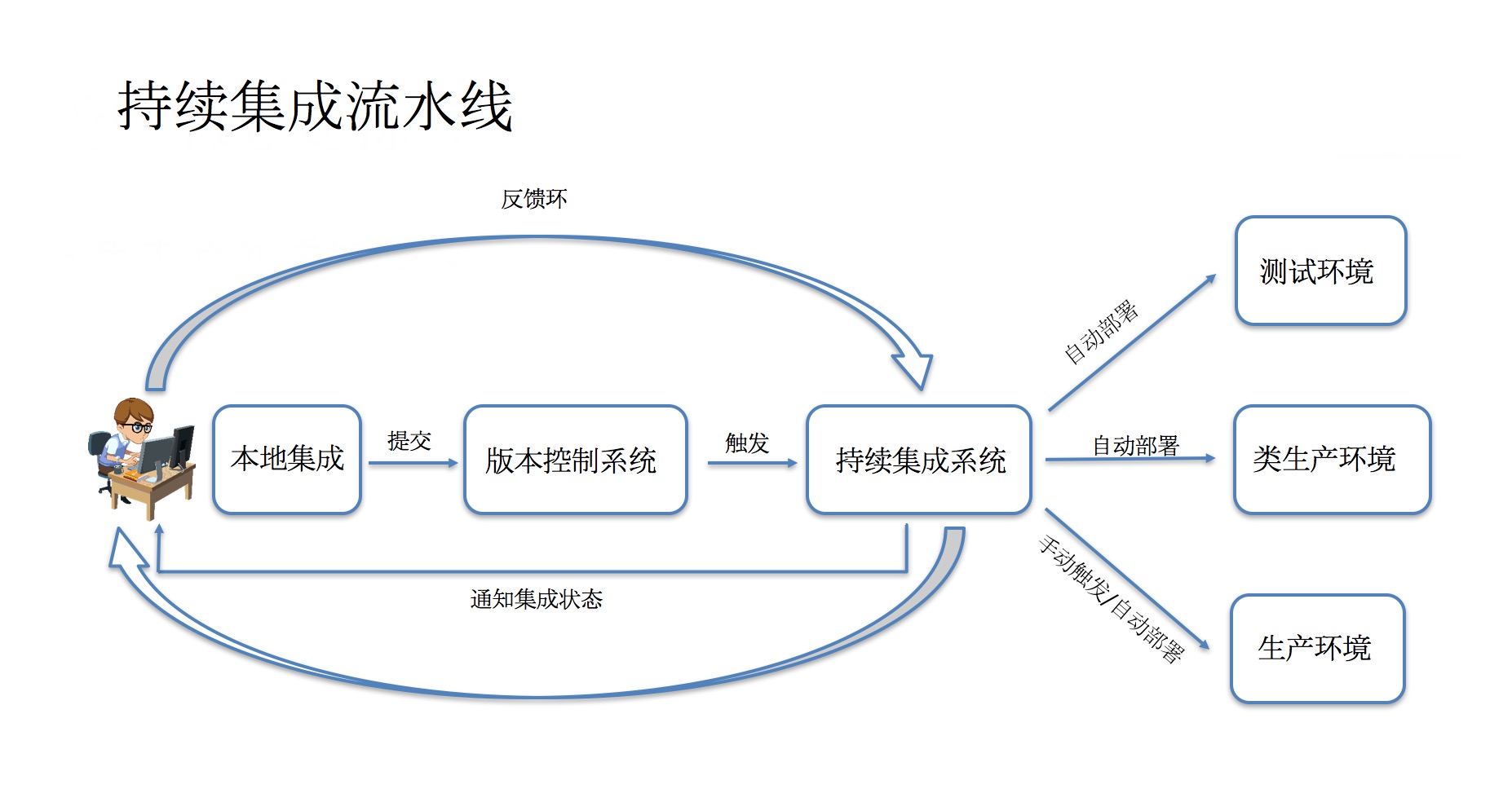

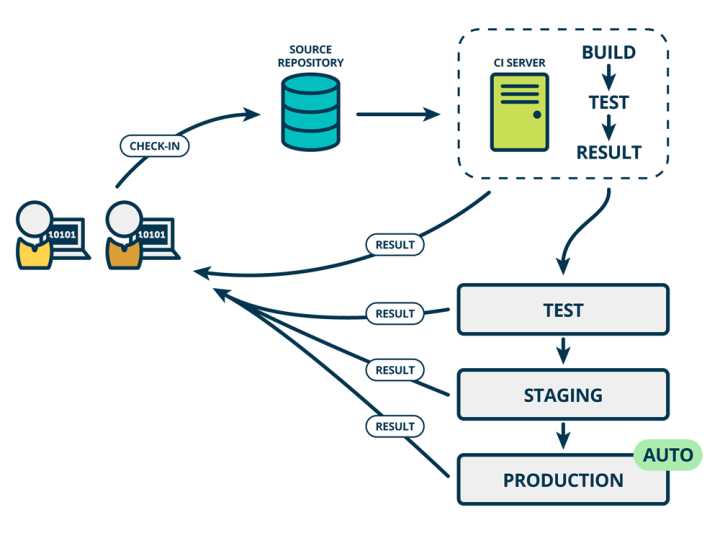

如上面所说,持续集成不能消除 bug ,但能更容易地发现 bug,更快速地修复,提升产品质量。那么,持续集成能给我们带来哪些价值? 从这张图上可以看到,持续集成形成一个完美的闭环。通过持续的集成进行不断地检查、调整,同时,项目的透明性也得到了最大的体现。fir.im 如何进行持续集成实践这是一个常见的持续集成流水线: 在日常的开发过程中,程序员在本地提交代码,持续集成流水线要求先做一次本地集成,在本地进行验证后提交到源代码管理仓库中,之后源代码工具会发出 webhook 触发到持续集成系统中。当构建/测试完成后,会及时通过钉钉或邮件通知团队(测试/研发/boss/产品经理)集成状态,产品经理或项目经理收到通知后会在测试环境做验收测试,这是一个比较完美的反馈环。假如测试通过验收完毕后,持续集成系统会自动触发部署到类生产环节或测试环境,或由专人手动部署到生产环境。为什么要做本地集成首先,代码在远程进行管理,每个人都会提交代码,远程的代码仓库会产生变化,所以在本地集成的时候要求进行代码合并,以免出现分支冲突和代码冲突。其次,不要依赖于持续集成系统给你结果,可能需要 30 分钟的时间,不要让开发人员等待,一定要先做本地集成。如何做版本提交再说一个提交的问题,我们尽量保证每一次提交都是一个完整的提交,也就是原子提交。“Continuous Integration doesn’t get rid of bugs, but it does make them dramatically easier to find and remove.” — Martin Fowler

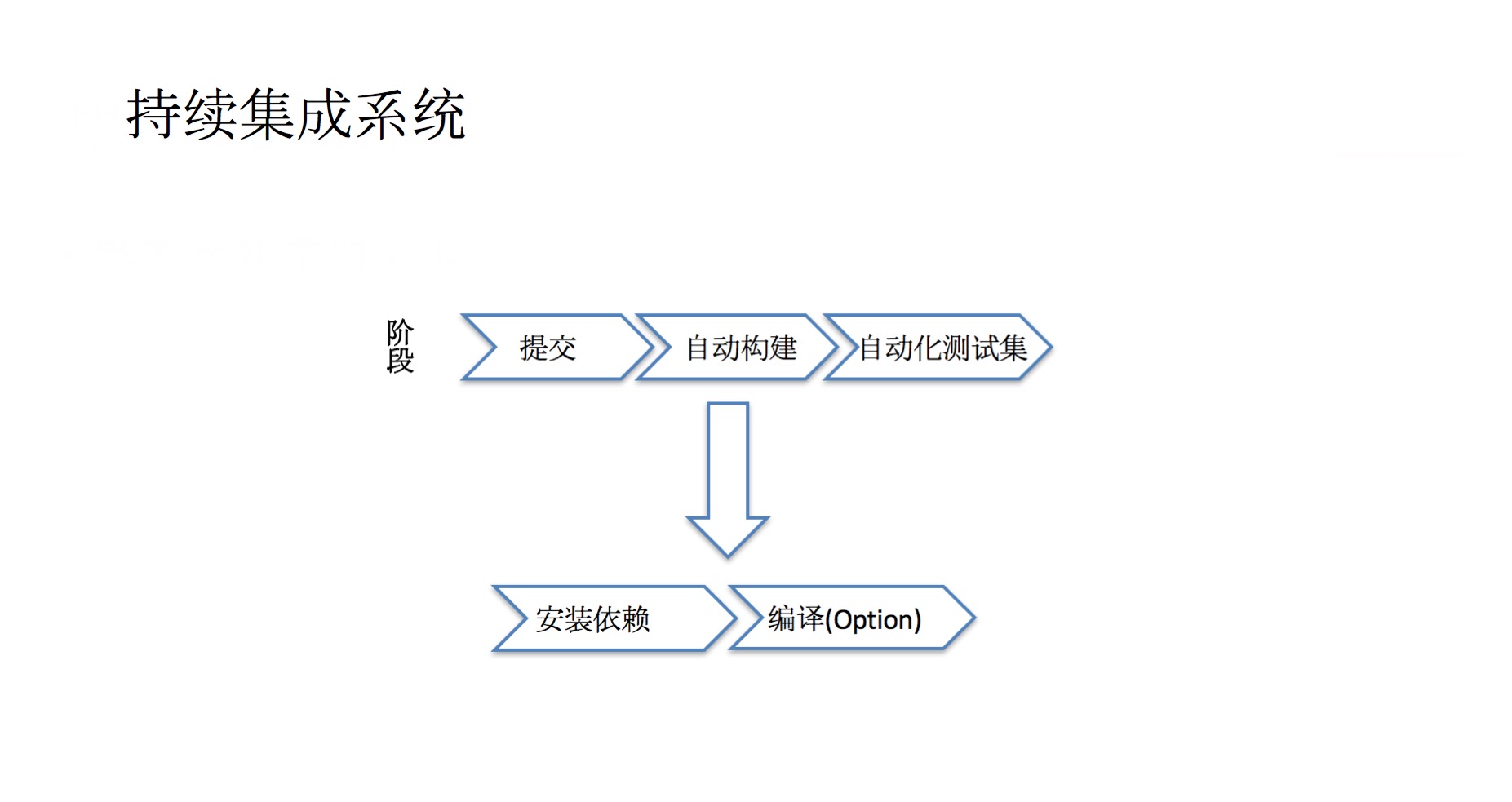

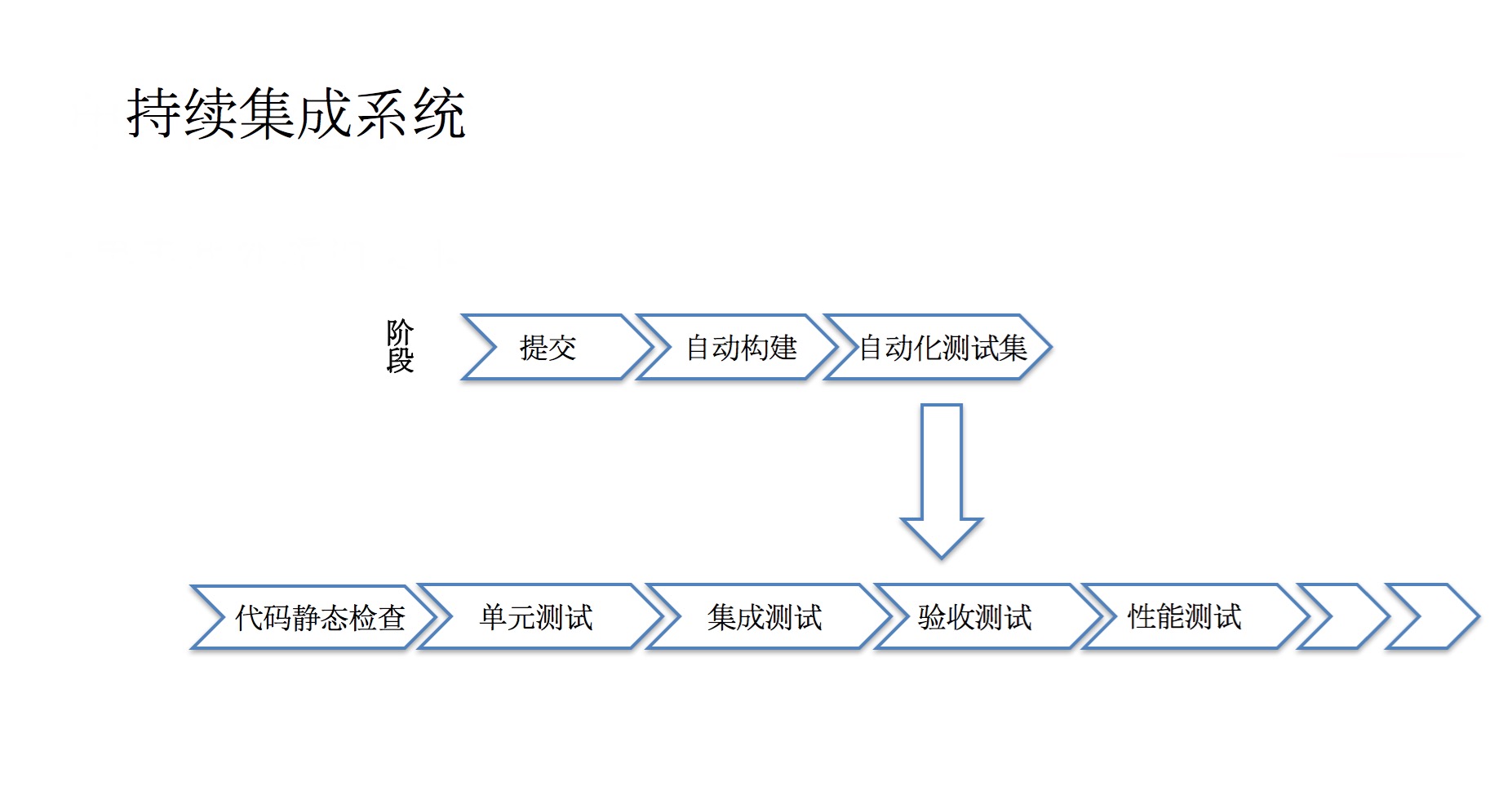

拿每个产品开发都会遇到的 login 功能开发举例,当填完的用户名和密码传到数据库,做完验证后给用户返回一个结果。那什么是一个原子提交?比如,提交验证一个用户名,这是一个完整的 feature ;验证密码是否符合格式(6位/8位),这也是一个完整的 feature ;当我验证完用户名和密码后再传到数据库之后,查询正确与否,这也是一个完整的 feature ;保证每次提交是一个完整的 feature 或修复了一个 bug,不要代码写成半截。持续集成系统这里讲的是狭义的持续集成系统,通常的 CI 系统收到提交之后会触发构建,构建会有信息返回比如 commit id 、commit 信息、代码变更等,收到代码提交后会触发自动构建,接着安装依赖进行编译,并触发质量保证流程,也就是说自动化测试集。 自动化测试集包括代码静态检查-单元测试-集成测试-验收测试-性能测试,也会有压力测试、回归测试、monkey test等等一系列的测试。 接下来,我们具体讲一下 fir.im 团队如何进行持续集成实践的。fir.im 的敏捷环境fir.im 是一个内测分发平台,我们也做了一个持续集成 CI 产品-flow.ci。先来看一下我们正在使用的敏捷环境:当代码变动你想创建提交时,这个提交应该尽可能的小量,并且包含一个不可分割的特性(feature)、修复(fix)或优化(improved)。

- Trello 看板;

- 三个环境(类生产环境,测试环境,生产环境);

- CI 工具(Jenkins/flow.ci)

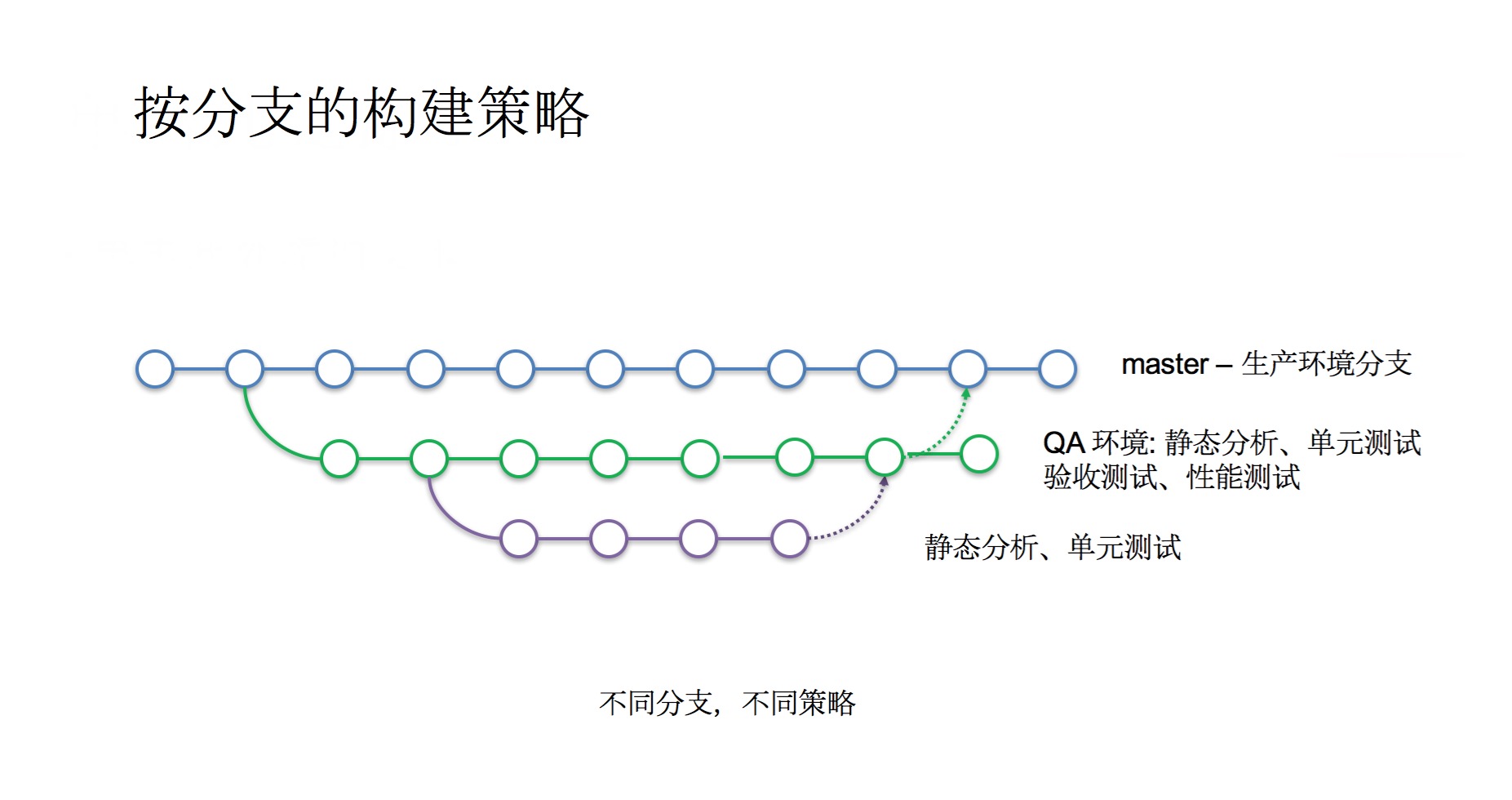

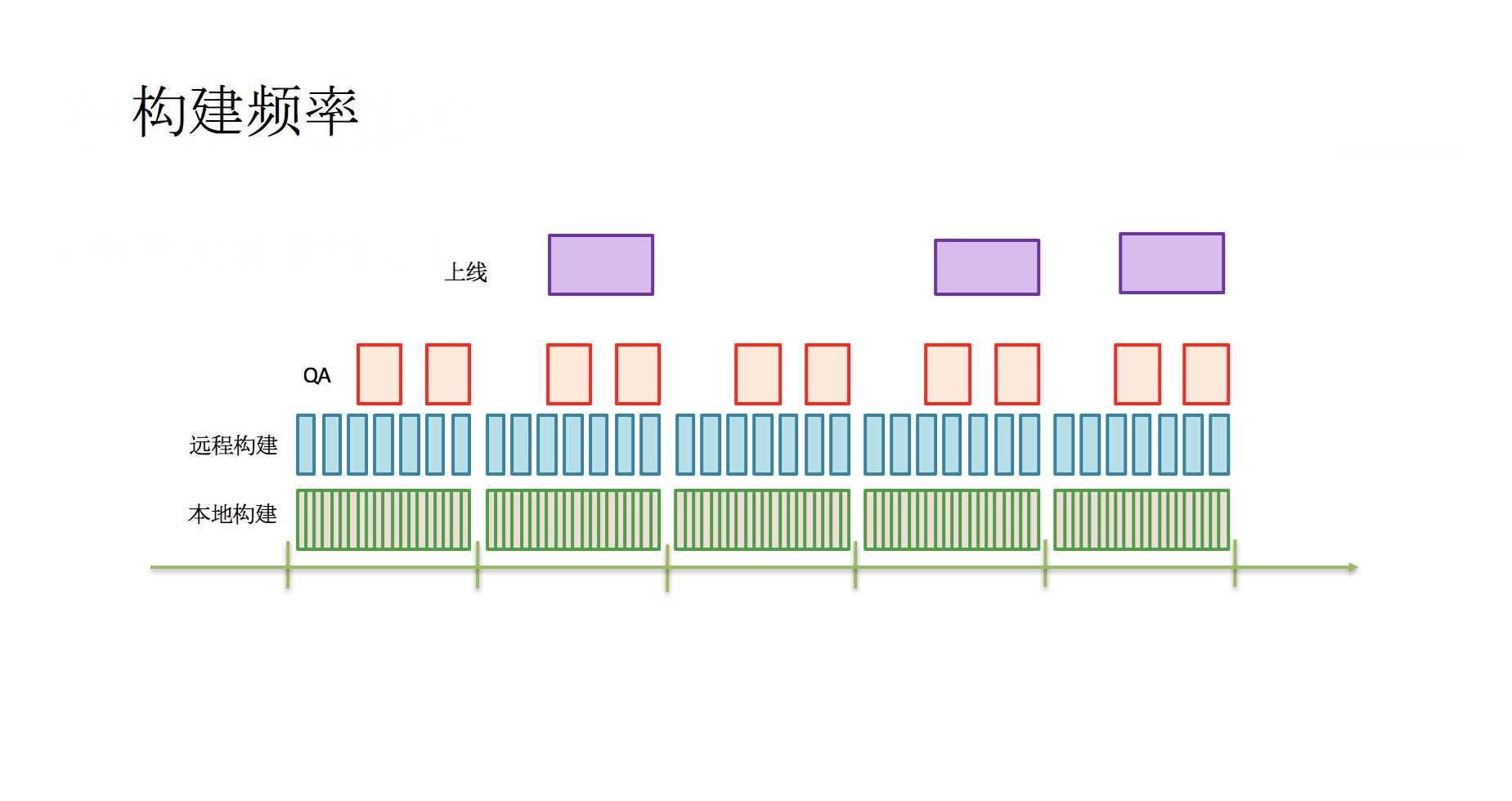

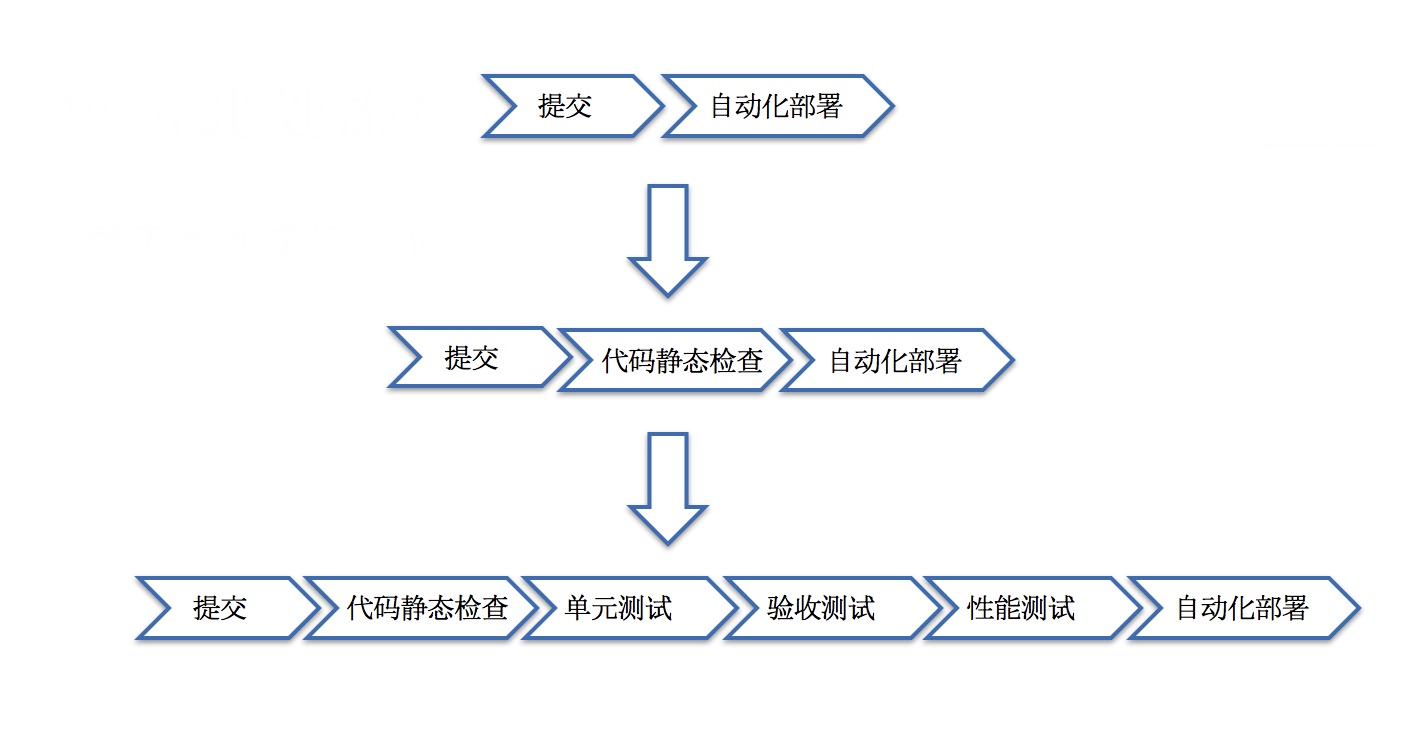

整个团队的构建频率可以看下这张图: 本地集成的频率非常高,远程构建对应的是 feature 分支,会相对低一下。QA 环境对应的是 develop 分支的构建粒度。这样的构建每天都会产生,所以做完之后不要积压,一定要保持上线节奏。 kanban + scrum 结合的方式构成我们每日构建,这是一个整体的构建策略和上线频率。fir.im 的持续集成系统演变过程罗马不是一天建成的,持续集成不是一开始就是完美的,每个开发者心中都有一个比较理想的自动化工作流——持续部署,大概会经历这几个演变阶段:我们会做代码 review ,当 feature 分支提 pr 到 develop 分支上,这样 develop 分支的构建条件是:当收到 pr 之后,开始跑持续集成。假如部署完成整个测试跑过了产品经理验收之后,没毛病了,终于可以发布了到 master 分支。

- 最初阶段:提交代码-自动部署;

- 一般进阶:提交代码-代码静态分析-自动部署,最简单先再加入代码静态分析;

- 高级进阶:提交代码-代码静态分析-自动化测试集-自动部署;

- 测试异常——不仅仅测试正确情况,也要主动测试异常;

- 减少耦合——保证独立的可测试性;

- 功能分离——单元测试流太长,超过 20 分钟的话要详细想一下如何将功能单独拆开,效率更高;

- 测试=需求——从测试代码看到每个 class 是干什么的,同时出现 bug 时,第一时间是看测试,想想如何从测试中复现;

Step 3. 验收测试

验收测试是端对端的测试,从收到用户名密码到返回结果,是不是我们所期望的一个值,这是验收 Acceptance Test,其实是验收了整个功能。代码静态检查和单元测试,保证了我们如何怎么去写代码,验收测试保证了写正确代码,符合开发需求。

flow.ci 做验收测试比较多,用的是比较流行的框架 Cucumber + Selenium WebDriver,目前支持 3 种数据库,5 种 git 仓库,7 种 开发语言跑在 docker 容器云上,支持 iOS 构建跑在 mac 机器上,要保证这些排列组合正常运行,这是 flow.ci 做验收测试最核心的价值。

其实,持续集成是一个工作流,当 push 代码的时候才会 run 起来,但是 flow.ci 本身系统也有外部依赖的特殊性,会依赖一些第三方的 sevice(比如 GitHub/GitLab 等),验收测试应该一直保持不断地运行,也可以叫持续测试吧。因为我们永远不能保证第三方的 api 会不会改变:)

Step 4. 性能测试

我们的性能测试做的比较简单,主要测试 api.因为 fir.im 做 app 的内测分发,我们需要性能测试保证 app 上传下载的正常稳定。性能测试是单用户的,压力测试是多用户的,这是两者之间的区别。

性能测试会有一些不确定性,有很多系统会产生缓存。flow.ci 的性能测试跑在 docker 上,是一个干净独立的环境,需要让系统预热运行一下。Locust/JMeter/LoadRunner是目前比较流行的性能测试工具。 flow.ci 目前用的是 locust,可以参考一下。

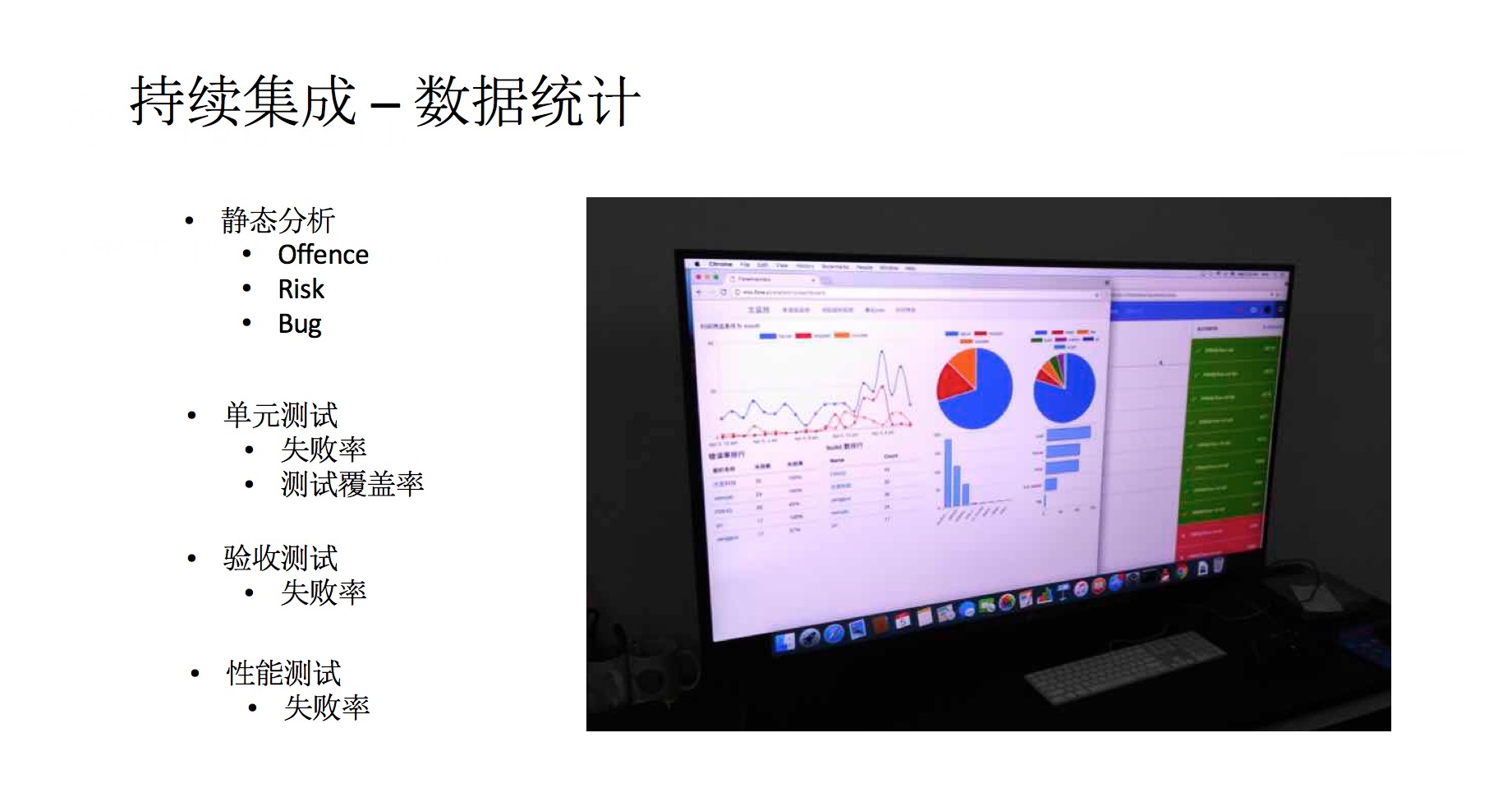

持续集成的可视化、数据分析

说到数据统计分析,整个 ci 流程跑下来产生的很多数据也非常有挖掘的价值。比如,对于代码静态分析有多少 Offence、Risk、Bug,对于单元测试有失败率、测试覆盖率;对于验收测试或性能测试有多少的失败率,这些数据都有可能成为衡量一个程序员的标准。

结语

CI 就像盖楼房的脚手架一样,没有脚手架就没办法盖出一个足够高的楼,没有 CI 就无法交付质量足够好的软件!

收起阅读 »

理解持续集成、持续交付、持续部署

持续集成

持续集成强调开发人员提交了新代码之后,立刻进行构建、(单元)测试。根据测试结果,我们可以确定新代码和原有代码能否正确地集成在一起。

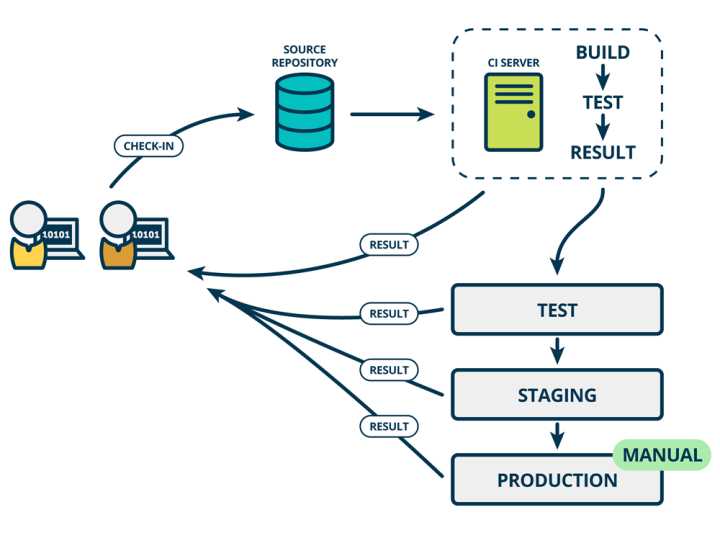

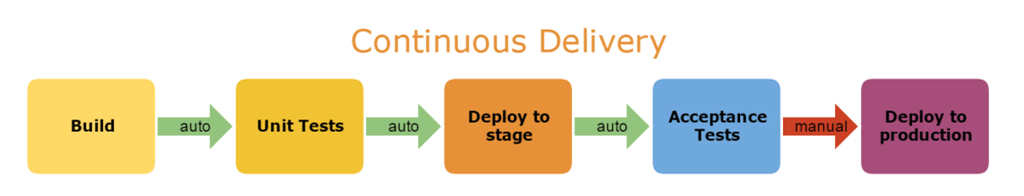

持续交付

持续交付在持续集成的基础上,将集成后的代码部署到更贴近真实运行环境的「类生产环境」(production-like environments)中。比如,我们完成单元测试后,可以把代码部署到连接数据库的 Staging 环境中更多的测试。如果代码没有问题,可以继续手动部署到生产环境中。

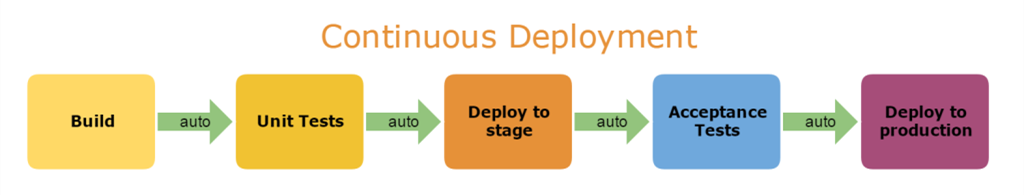

持续部署

持续部署则是在持续交付的基础上,把部署到生产环境的过程自动化。我个人觉得持续集成、持续交付、持续部署非常值得推广。开发过程中最怕集成时遇到问题导致返工,而持续集成、持续交付、持续部署恰恰可以早发现早解决,从而可以避免这个问题。

参考:https://www.mindtheproduct.com/2016/02/what-the-hell-are-ci-cd-and-devops-a-cheatsheet-for-the-rest-of-us/ 收起阅读 »

谈谈持续集成、持续交付、持续部署之间的区别

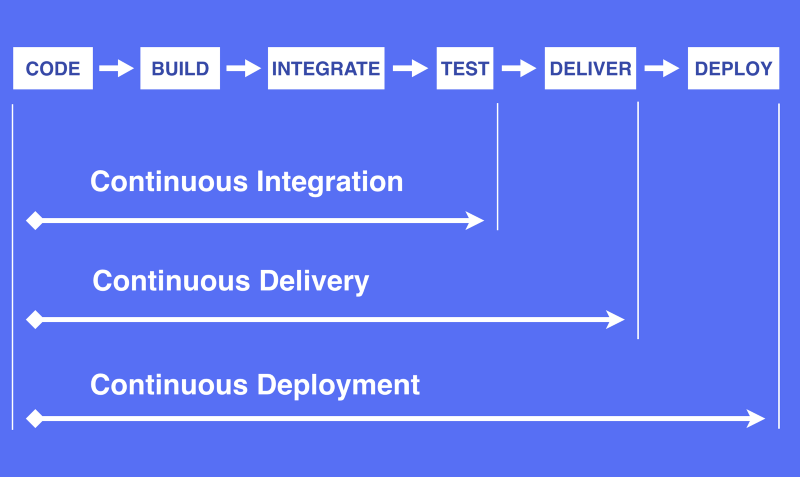

假如把开发工作流程分为以下几个阶段:

编码 ---> 构建 ---> 集成 ---> 测试 ---> 交付 ---> 部署

正如你在上图中看到,「持续集成(Continuous Integration)」、「持续交付(Continuous Delivery)」和「持续部署(Continuous Deployment)」有着不同的软件自动化交付周期。

持续集成

持续集成是指软件个人研发的部分向软件整体部分交付,频繁进行集成以便更快地发现其中的错误。“持续集成”源自于极限编程(XP),是 XP 最初的 12 种实践之一。

CI 需要具备这些:

- 全面的自动化测试: 这是实践持续集成&持续部署的基础,同时,选择合适的自动化测试工具也极其重要;

- 灵活的基础设施: 容器,虚拟机的存在让开发人员和 QA 人员不必再大费周折;

- 版本控制工具: 如 Git,CVS,SVN 等;

- 自动化的构建和软件发布流程的工具,如 Jenkins,flow.ci;

- 反馈机制: 如构建/测试的失败,可以快速地反馈到相关负责人,以尽快解决达到一个更稳定的版本。

- “快速失败”,在对产品没有风险的情况下进行测试,并快速响应;

- 最大限度地减少风险,降低修复错误代码的成本;

- 将重复性的手工流程自动化,让工程师更加专注于代码;

- 保持频繁部署,快速生成可部署的软件;

- 提高项目的能见度,方便团队成员了解项目的进度和成熟度;

- 增强开发人员对软件产品的信心,帮助建立更好的工程师文化。

- 快速发布。能够应对业务需求,并更快地实现软件价值。

- 编码->测试->上线->交付的频繁迭代周期缩短,同时获得迅速反馈;

- 高质量的软件发布标准。整个交付过程标准化、可重复、可靠,

- 整个交付过程进度可视化,方便团队人员了解项目成熟度;

- 更先进的团队协作方式。从需求分析、产品的用户体验到交互 设计、开发、测试、运维等角色密切协作,相比于传统的瀑布式软件团队,更少浪费。

持续部署

持续部署是指当交付的代码通过评审之后,自动部署到生产环境中。持续部署是持续交付的最高阶段。这意味着,所有通过了一系列的自动化测试的改动都将自动部署到生产环境。它也可以被称为“Continuous Release”。

为什么说持续部署是理想的工作流程?

“开发人员提交代码,持续集成服务器获取代码,执行单元测试,根据测试结果决定是否部署到预演环境,如果成功部署到预演环境,进行整体验收测试,如果测试通过,自动部署到产品环境,全程自动化高效运转。”

实际上,产品在从需求到部署的过程中,会经历若干种不同的环境,例如 QA 环境、各种自动化测试运行环境、生产环境等。这些环境的搭建、配置、管理,产品在不同环 境中的具体部署,状况是比较非常复杂的,从头到尾地全自动持续部署的确困难。那么,如果能做到持续交付,保证代码在模拟环境没问题,也许团队成员做到真正的心理有数。

持续部署的优点:

持续部署主要好处是,可以相对独立地部署新的功能,并能快速地收集真实用户的反馈。

“You build it, you run it”,这是 Amazon 一年可以完成 5000 万次部署,平均每个工程师每天部署超过 50 次的核心秘籍。

最后

「持续集成(Continuous Integration)」、「持续交付(Continuous Delivery)」和「持续部署(Continuous Deployment)」提供了一个优秀的 DevOps 环境,对于整个团队来说,好处与挑战并行。无论如何,频繁部署、快速交付以及开发测试流程自动化都将成为未来软件工程的重要组成部分。

分享阅读链接:http://www.jianshu.com/p/2c6ebe34744a

來源:简书

收起阅读 »

VMware Workspace ONE为企业搭建数字化工作空间

VMware Workspace ONE专为提供整合设备管理、应用交付以及身份管理的数字化工作空间而设计。

它将多种优势集中在单一移动平台上,帮助企业IT部门为员工交付关键业务资源,并进行安全管理,支持终端用户实现消费级简单访问。

统一企业应用商店

通过AirWatch与Apple Volume Purchase Program(VPP)集成,可批量购买应用程序。AirWatch 通过与 Apple VPP (Volume Purchase Program) 和 Windows Store for Business 的集成来提供软件许可证管理。

统一身份管理

企业应用的身份管理依然面临着诸如:每个应用都要求有一套用户身份、用户需要记忆多个用户帐号、遗留帐号没有跟AD相集成等难题,Workspace ONE可以对身份进行统一管理,避免空间的浪费。

完善的完全保护机制

VMware的Workspace ONE平台将策略实施重新掌握在IT的手中,同时为用户提供灵活的隐私级别的服务,且无需记住登录或使用公司提供的机器。 SDDC和混合云实现了政策控制和灵活性的混合,为Workspace ONE平台的关键特性奠定了基础。

Workspace ONE是市场上唯一可以在整个堆栈中提供安全和管理的集成解决方案。

统一端点管理

Workspace ONE利用业界领先的EMM管理技术+传统的PC管理功能,管理各种Windows 10设备。AirWatch汇集了EMM和传统方法的最佳选择。完整的管理生命周期,从部署开始、管理设备和应用程序,实施安全性以及启用IT和最终用户。

设备调配

不再是刷系统镜像

登录到云端的Azure AD使用AirWatch来注册设备,开箱即用的用户体验 (开机可用就绪)。

配置系统策略

空中配置设备

安装或删除应用设置各种系统配置 (email、VPN、Wi-Fi……) 配置IT策略 (passwords、OS限制……)。

管理操作系统更新

告别 “Patch Tuesdays”

跟最新的Windows更新保持一致,管理安全和新特性更新安排系统维护窗口。

数字化工作空间不仅帮助企业IT部门实现更加高效且轻松的管理用户、设备与应用,它为业务部门构建与再建业务流程提供了一个安全且强大的平台,支持用户的移动业务能够更加有效地参与市场竞争。

想了解更多?敬请关注11月2日14 : 00“VMware——拥抱数字化工作空间”直播活动,听大咖与您分享,Workspace ONE如何为企业打造不一样的数字空间。

看直播·赢好礼

VR3D眼镜、手机特效镜头、硬盘包

等您来拿

直播间地址:“VMware——拥抱数字化工作空间” 收起阅读 »

Apache Solr/Lucene 0Day远程代码执行漏洞安全预警

影响范围:

Solr 5.5.0 to 5.5.4

Solr 6.0.0 to 6.6.1

Solr 7.0.0 to 7.0.1

修复方案:

升级到官方提供的安全修复版本:

Solr 6.6.2

Solr 7.1.0

漏洞详情:

CVE-2017-12629:Apache Solr存在XXE和RCE漏洞:

- lucene xml解析器没有明确禁止doctype 外部实体的声明,黑客可通过构造恶意的XML请求来读取服务器任意文件,导致信息泄露。

- Apache Solr“RunExecutableListener”类可以通过恶意的请求来执行任意操作,导致服务器被控制。

参考链接:

https://issues.apache.org/jira/browse/SOLR-11482

https://issues.apache.org/jira/browse/SOLR-11477 收起阅读 »

CentOS系统自动下载RPM包及其所有依赖的包

方法1利用"Downloadonly"插件下载 RPM 软件包及其所有依赖包

我们可以通过 yum 命令的 “Downloadonly” 插件下载 RPM 软件包及其所有依赖包, 为了安装 Downloadonly 插件,以 root 身份运行以下命令:

yum install yum-plugin-downloadonly现在,运行以下命令去下载一个 RPM 软件包

yum install --downloadonly默认情况下,这个命令将会下载并把软件包保存到 /var/cache/yum/ 的 rhel-{arch}-channel/packageslocation 目录,不过,你也可以下载和保存软件包到任何位置,你可以通过 –downloaddir 选项来指定。

yum install --downloadonly --downloaddir=例子:

yum install --downloadonly --downloaddir=/root/mypackages/ httpd终端输出:

Loaded plugins: fastestmirror

Loading mirror speeds from cached hostfile

* base: centos.excellmedia.net

* epel: epel.mirror.angkasa.id

* extras: centos.excellmedia.net

* updates: centos.excellmedia.net

Resolving Dependencies

--> Running transaction check

---> Package httpd.x86_64 0:2.4.6-40.el7.centos.4 will be installed

--> Processing Dependency: httpd-tools = 2.4.6-40.el7.centos.4 for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Processing Dependency: /etc/mime.types for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Processing Dependency: libaprutil-1.so.0()(64bit) for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Processing Dependency: libapr-1.so.0()(64bit) for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Running transaction check

---> Package apr.x86_64 0:1.4.8-3.el7 will be installed

---> Package apr-util.x86_64 0:1.5.2-6.el7 will be installed

---> Package httpd-tools.x86_64 0:2.4.6-40.el7.centos.4 will be installed

---> Package mailcap.noarch 0:2.1.41-2.el7 will be installed

--> Finished Dependency Resolution

Dependencies Resolved

=======================================================================================================================================

Package Arch Version Repository Size

=======================================================================================================================================

Installing:

httpd x86_64 2.4.6-40.el7.centos.4 updates 2.7 M

Installing for dependencies:

apr x86_64 1.4.8-3.el7 base 103 k

apr-util x86_64 1.5.2-6.el7 base 92 k

httpd-tools x86_64 2.4.6-40.el7.centos.4 updates 83 k

mailcap noarch 2.1.41-2.el7 base 31 k

Transaction Summary

=======================================================================================================================================

Install 1 Package (+4 Dependent packages)

Total download size: 3.0 M

Installed size: 10 M

Background downloading packages, then exiting:

(1/5): apr-1.4.8-3.el7.x86_64.rpm | 103 kB 00:00:01

(2/5): apr-util-1.5.2-6.el7.x86_64.rpm | 92 kB 00:00:01

(3/5): mailcap-2.1.41-2.el7.noarch.rpm | 31 kB 00:00:01

(4/5): httpd-tools-2.4.6-40.el7.centos.4.x86_64.rpm | 83 kB 00:00:01

(5/5): httpd-2.4.6-40.el7.centos.4.x86_64.rpm | 2.7 MB 00:00:09

---------------------------------------------------------------------------------------------------------------------------------------

Total 331 kB/s | 3.0 MB 00:00:09

exiting because "Download Only" specified

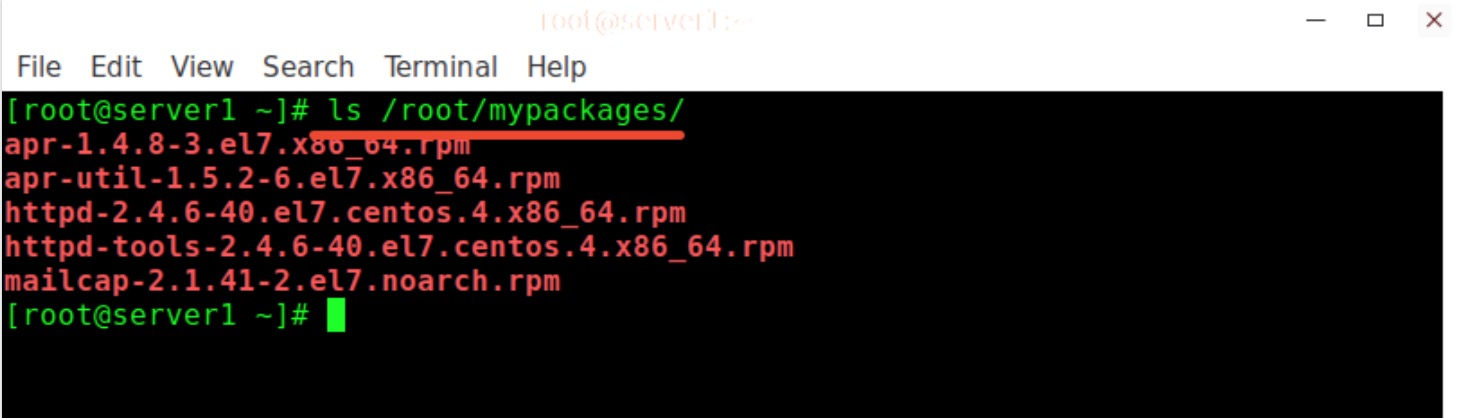

现在去你指定的目录位置下,你将会看到那里有下载好的软件包和依赖的软件。在我这种情况下,我已经把软件包下载到 /root/mypackages/ 目录下。

让我们来查看一下内容:

ls /root/mypackages/样本输出:

apr-1.4.8-3.el7.x86_64.rpm

apr-util-1.5.2-6.el7.x86_64.rpm

httpd-2.4.6-40.el7.centos.4.x86_64.rpm

httpd-tools-2.4.6-40.el7.centos.4.x86_64.rpm

mailcap-2.1.41-2.el7.noarch.rpm

正如你在上面输出所看到的, httpd软件包已经被依据所有依赖性下载完成了 。

请注意,这个插件适用于 yum install/yum update, 但是并不适用于 yum groupinstall。默认情况下,这个插件将会下载仓库中最新可用的软件包。然而你可以通过指定版本号来下载某个特定的软件版本。

例子:

yum install --downloadonly --downloaddir=/root/mypackages/ httpd-2.2.6-40.el7此外,你也可以如下一次性下载多个包:

yum install --downloadonly --downloaddir=/root/mypackages/ httpd vsftpd

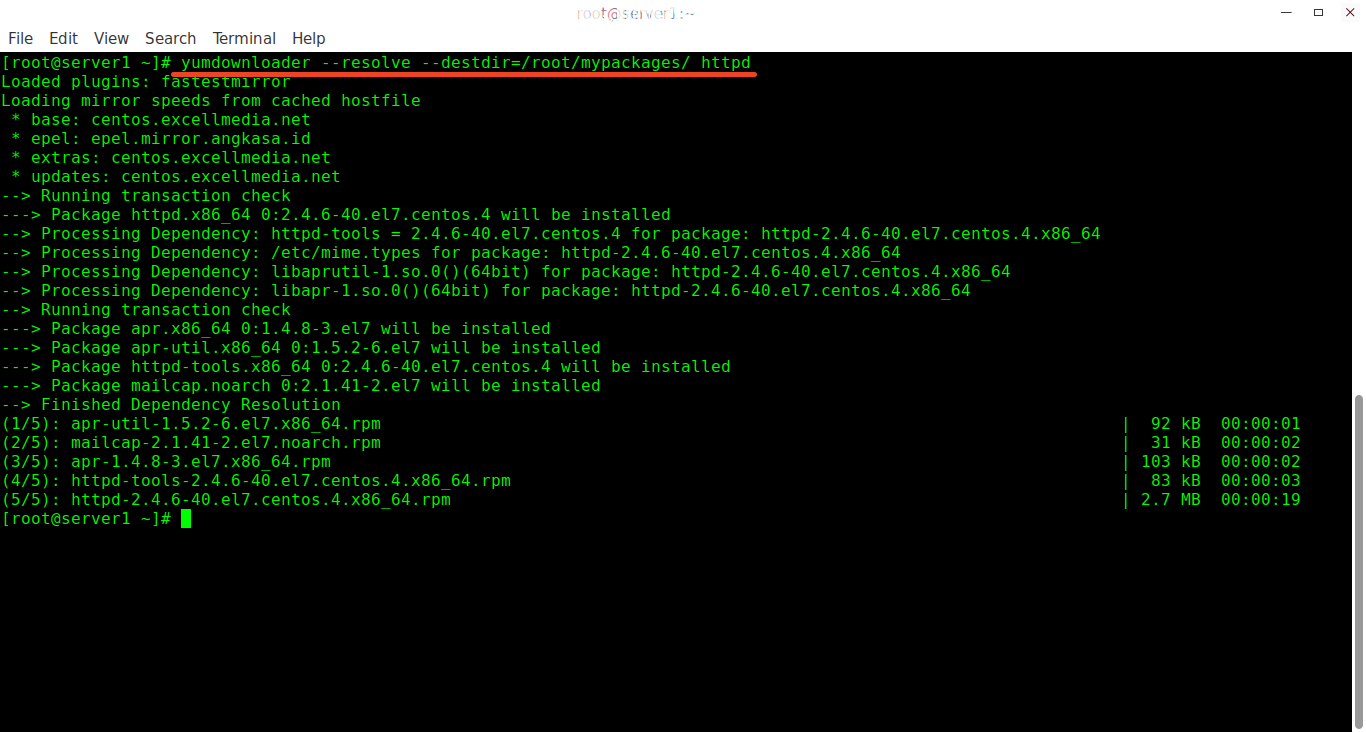

方法 2 使用 "Yumdownloader"工具来下载 RPM 软件包及其所有依赖包

“Yumdownloader” 是一款简单,但是却十分有用的命令行工具,它可以一次性下载任何 RPM 软件包及其所有依赖包。

以 root 身份运行如下命令安装 “Yumdownloader” 工具。

yum install yum-utils一旦安装完成,运行如下命令去下载一个软件包,例如 httpd:

yumdownloader httpd为了根据所有依赖性下载软件包,我们使用 --resolve 参数:

yumdownloader --resolve httpd默认情况下,Yumdownloader 将会下载软件包到当前工作目录下。

为了将软件下载到一个特定的目录下,我们使用 --destdir 参数:

yumdownloader --resolve --destdir=/root/mypackages/ httpd或者

yumdownloader --resolve --destdir /root/mypackages/ httpd终端输出:

Loaded plugins: fastestmirror

Loading mirror speeds from cached hostfile

* base: centos.excellmedia.net

* epel: epel.mirror.angkasa.id

* extras: centos.excellmedia.net

* updates: centos.excellmedia.net

--> Running transaction check

---> Package httpd.x86_64 0:2.4.6-40.el7.centos.4 will be installed

--> Processing Dependency: httpd-tools = 2.4.6-40.el7.centos.4 for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Processing Dependency: /etc/mime.types for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Processing Dependency: libaprutil-1.so.0()(64bit) for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Processing Dependency: libapr-1.so.0()(64bit) for package: httpd-2.4.6-40.el7.centos.4.x86_64

--> Running transaction check

---> Package apr.x86_64 0:1.4.8-3.el7 will be installed

---> Package apr-util.x86_64 0:1.5.2-6.el7 will be installed

---> Package httpd-tools.x86_64 0:2.4.6-40.el7.centos.4 will be installed

---> Package mailcap.noarch 0:2.1.41-2.el7 will be installed

--> Finished Dependency Resolution

(1/5): apr-util-1.5.2-6.el7.x86_64.rpm | 92 kB 00:00:01

(2/5): mailcap-2.1.41-2.el7.noarch.rpm | 31 kB 00:00:02

(3/5): apr-1.4.8-3.el7.x86_64.rpm | 103 kB 00:00:02

(4/5): httpd-tools-2.4.6-40.el7.centos.4.x86_64.rpm | 83 kB 00:00:03

(5/5): httpd-2.4.6-40.el7.centos.4.x86_64.rpm | 2.7 MB 00:00:19

让我们确认一下软件包是否被下载到我们指定的目录下:

ls /root/mypackages/终端输出:

apr-1.4.8-3.el7.x86_64.rpm

apr-util-1.5.2-6.el7.x86_64.rpm

httpd-2.4.6-40.el7.centos.4.x86_64.rpm

httpd-tools-2.4.6-40.el7.centos.4.x86_64.rpm

mailcap-2.1.41-2.el7.noarch.rpm

不像 Downloadonly 插件,Yumdownload 可以下载一组相关的软件包。

yumdownloader "@Development Tools" --resolve --destdir /root/mypackages/在我看来,我喜欢 Yumdownloader 更胜于 Yum 的 Downloadonly 插件。但是,两者都是十分简单易懂而且可以完成相同的工作。

这就是今天所有的内容,如果你觉得这份引导教程有用,清在你的社交媒体上面分享一下去让更多的人知道。

阅读分享,英文:https://www.ostechnix.com/download-rpm-package-dependencies-centos/ 中文:https://linux.cn/article-7937-1.html 收起阅读 »

访问服务器为什么需要智能身份识别

Checkpoint防火墙主要是通过以下几种方式获取用户身份

1、AD query

通过微软Ad server来获得用户的身份信息、适用于大型网络,用户较多的环境。结合AD域只针对用户的AD记录来进行认证,不再针对IP地址一类信息。

(1) 安全网关从AD服务器上获得安全事件日志;

(2) 用户登录到域;

(3) 域服务器发送安全事件日志给安全网关,安全网关获取到用户的IP和用户相关信息(如用户的域信息,计算机名和源IP地址);

(4) 用户要访问Internet;

(5) 安全网关确认用户身份后,根据策略决定是否允许用户访问Internet。

2、通过浏览器捕获身份

使用基于浏览器捕获身份认证信息。适用于非微软AD用户,通过浏览器来访问web资源。

流程如下:

(1) 用户从外部发起到datacenter的访问;

(2) 防火墙IA模块没有识别出用户,然后重定向用户的访问至Web portal界面;

(3) 用户输入自己的认证信息:可以使AD/LDAP/RADIUS等;

(4) 认证信息被发送至防火墙,之后防火墙通过后边所连接的AD server来返回用户的认证结果;

(5) 如果允许,则放通访问;

(6) 如果不允许,则不能通过访问。

3、通过agent获得用户身份

基于agent的认证类型有两种:

(1) Endpoint Identity Agent:安装在用户PC上。

(2) Terminal Servers Endpoint Identity Agent:安装在虚拟桌面系统中,能够识别同一IP源地址的不同用户。

认证流程如下:

(1) 用户发起到datacenter访问;

(2) 启用IA的安全网关向用户弹出web认证页面;

(3) 用户在web界面中点击下载agent的链接;

(4) 用户下载并安装Endpoint Identity Agent;

(5) 用户通过这个agent去连接安全网关;

(6) 用户认证通过,安全网关根据安全策略决定是否发起用户到目的地址的访问。

相同之处:

都有一个安全的身份识别的过程,都需要流量经过防火墙,然后通过防火墙来结合(AD域)来达到用户识别的目的。

不同之处:

有的是用浏览器来获取用户身份,而有的是用客户端来识别,还有结合浏览器和AD域来识别。

学习完整Check point智能身份识别课程,请点击“Check point智能身份识别” 收起阅读 »